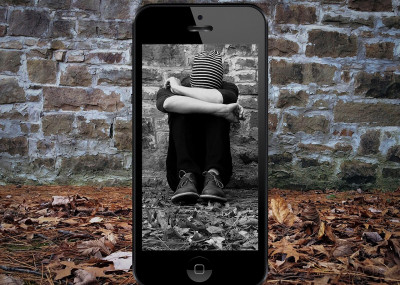

Etwa 95% der deutschen Jugendlichen im Alter von 12-19 Jahren besitzen ein Smartphone (vgl. JIM-Studie 2025) und haben damit Zugang zu sozialen Medien. Diese bieten vielfältige Möglichkeiten, sich zu informieren, kreativ auszudrücken und mit anderen Menschen zu vernetzen. Allerdings sind mit ihrer Nutzung auch verschiedene Herausforderungen und Gefahren verbunden, wie beispielsweise Cybermobbing. So haben laut einer Studie der WHO ein Sechstel der Jugendlichen in der EU im Alter von 11-15 Jahren persönlich Cybermobbing erlebt, ein Achtel selbst andere Personen online gemobbt. Unter den Teilnehmenden Jugendlichen zwischen 12 und 17 Jahren, die für diesen Aktionsplan befragt wurden, waren sogar ein Viertel selbst von Cybermobbing betroffen.

Opfer von Cybermobbing sind einem erhöhten Risiko für Angstzustände, Depressionen, Einsamkeit, Selbstverletzung und suizidalem Verhalten ausgesetzt und neigen eher zu Verhaltensauffälligkeiten, einschließlich schädlicher Bewältigungsstrategien.

In verschiedenen Ländern wird gerade über ein "Social-Media-Verbot", bzw. die Einführung eines verbindlichen Mindestalters für den Zugang zu sozialen Medien und elterliche Kontrollmöglichkeiten diskutiert - in Australien wurde es bereits umgesetzt. Für die EU soll bis zum Sommer 2026 ein Expertenrat mit Blick auf die Online-Risiken Empfehlungen zu Altersbeschränkungen in sozialen Medien geben.

Nun hat die EU-Kommission einen Aktionsplan gegen Cybermobbing vorgelegt, um dieses zu bekämpfen, Kinder und Jugendliche zu schützen sowie Betroffene zu unterstützen.

Der Aktionsplan besteht aus drei Säulen:

1. koordiniertes EU-Schutzkonzept

2. Prävention und Sensibilisierung

3. Berichterstattung und umfassende Unterstützung

Durch den Aktionsplan soll innerhalb der Mitgliedsstaaten ein gemeinsames Verständnis von Cybermobbing entwickelt werden. Die Kommission will die bestehenden Leit- und Richtlinien besonders im Hinblick auf Cybermobbing überarbeiten und ergänzen. Das betrifft vor allem den Digital Servic Act (DSA), den Audiovisual Media Services Directive (AVMSD) und den AI Act. Ziel ist, dass digitale Plattformen ihre volle Verantwortung für die Aufdeckung und Bekämpfung von Cybermobbing wahrnehmen, Meldesysteme verbessert werden und ein Verhaltenskodex zur Kennzeichnung und Beschriftung von KI-generierten Inhalten durchgesetzt wird.

Die Mitgliedsstaaten sollen umfassende nationale Pläne zur Bekämpfung von (Cyber-)Mobbing auf Basis des EU-Netzwerks für Kinderrechte und den Empfehlungen der Kommission zu integrierten Kinderschutzsystemen erstellen. Mit Unterstützung des Netzwerks der Safer Internet Centres (SIC) und der Plattform „Better Internet for Kids“ (BIK) sollen die Mitgliedsstaaten vergleichbare Daten zum Cybermobbing zu erheben und gemeinsame Standards für die Bekämpfung von Cybermobbing in der gesamten EU erarbeiten.

Außerdem sollen Ressourcen und Schulungen zum Thema Cybermobbing für Schulen und außerschulische Bildung über die BIK-Plattform, die SICs, das Europäische Jugendportal und die Europäische Plattform für Schulbildung ausgebaut werden. Ziel ist es, alle gesellschaftlichen Gruppen mit Informationen zu erreichen, um das Bewusstsein dafür zu schärfen, wie Cybermobbing aussieht, wie es verhindert werden kann und wie Opfer unterstützt werden können. Dafür sollen Mitgliedsstaaten Pädagog*innen, Betreuer*innen und Fachkräfte, die in verschiedenen Bereichen mit Kindern arbeiten, mit klaren Leitlinien stärken, um Cybermobbing präventiv zu thematisieren oder im Frühstadium zu erkennen. Außerdem sollen Kinder an der Gestaltung und Umsetzung von Maßnahmen beteiligt werden.

Für die Unterstützung von Betroffenen soll Ende 2026 eine barrierefreien Online-Sicherheits-App in allen Mitgliedstaaten eingeführt werden, die eine einfache Meldung von Cybermobbing ermöglich und an die nationalen Gegebenheiten angepasst ist (z.B. bestehende Meldesysteme und Helplines integriert).